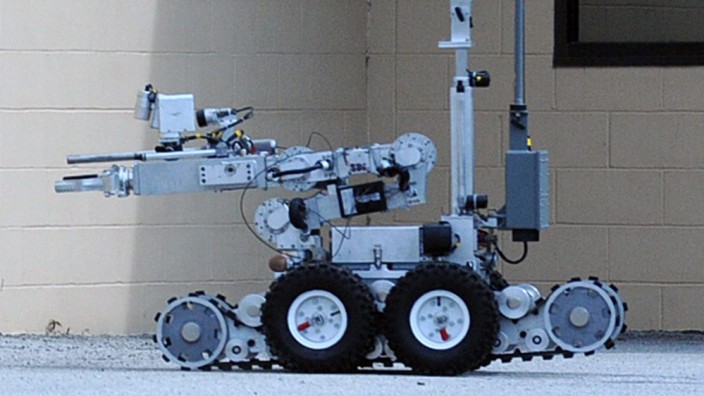

Der Remotec Andros Mark V-A1 wiegt knapp 360 Kilogramm, ist mit einer Kamera ausgestattet und fährt mit einer Geschwindigkeit von 6 Kilometern pro Stunde. Der Roboter schaut eigentlich gar nicht bedrohlich aus, eher ein bisschen behäbig. Trotzdem hat die Polizei vergangene Woche mit seiner Hilfe den Heckenschützen von Dallas getötet.

Das Fahrzeug des Rüstungskonzerns Northrop Grumman ist kein Killer-Roboter, wie man sie aus Science-Fiction-Filmen kennt. Die Polizisten verwandelten das Gerät in eine tödliche Waffe, indem sie einen Sprengsatz am Greifarm montierten. Der Roboter muss dabei von einem Menschen ferngesteuert werden, kann also nicht zur autonomen Tötungs-Maschine werden, die selbstständig Menschen umbringt.

Trotzdem schließen sich an den Einsatz weitreichende rechtliche und moralische Fragen an. Haben die Beamten in Dallas richtig gehandelt? Rüstet die Polizei sich jetzt flächendeckend mit solchen Robotern aus, um zukünftig keine Spezialeinheit mehr schicken zu müssen? Macht es einen Unterschied, ob ein Scharfschütze aus der Ferne schießt oder ein Polizist einen Knopf drückt und damit die Bombe an einem Roboter zündet?

Die Entscheidung war "sorgfältig getroffen"

Jemand, der diese Fragen beantworten könnte, ist Ian Kerr. Er leitet an der University of Ottawa die Abteilung für Ethik, Recht und Technologie und setzt sich für einen Stopp von Killer-Robotern ein. "Ich bin der Ansicht, dass das Töten von Menschen eine derart grundlegende moralische und juristische Frage ist, dass wir diese nicht an Maschinen weiterreichen sollten", sagt er. Autonom handelnde Tötungsmaschinen lehnt er also entschieden ab.

Im Falle des Einsatzes in Dalls sagt Kerr allerdings, dass er mit der Polizei mitfühlen und ihre "sorgfältig getroffene" Entscheidung nachvollziehen könne. Der Einzeltäter erschoss fünf Menschen und verletzte neun weitere. Die Polizei wusste zu diesem Zeitpunkt nicht, ob Micah Johnson im Alleingang handelte. David Brown, Polizeichef von Dallas, gab später bekannt, wegen des Bomben-Roboters kein schlechtes Gewissen zu haben: "Andere Optionen hätten für unsere Polizisten große Gefahr bedeutet."

Auch der Bürgermeister der Stadt, Mike Rawlings, stellte sich demonstrativ hinter die Polizei. Es sei die richtige Entscheidung gewesen: "Wir haben den Täter gefragt: 'Willst du dich gefahrlos ergeben oder willst du dort bleiben? Wir werden dich beseitigen.' Er hat sich für das Letztere entschieden."

Die Polizei hat einen Präzedenzfall geschaffen

"Rein moralisch gesehen hätte ich mir dennoch gewünscht, dass sie keinen Roboter eingesetzt hätten", sagt Kerr. Da sich die Polizei nun für diese Lösung entschieden habe, sei ein Präzedenzfall geschaffen worden: "Es ist einfach, sich vorzustellen, dass sich die Idee 'Hey, wir können einen Roboter hinschicken' plötzlich wandelt: 'Wir hatten keine andere Wahl als einen Roboter hinzuschicken'."

Kerr weist darauf hin, dass der Roboter im Fall Dallas zwei Eigenschaften mit sich bringe. Zum einen die reduzierte Nähe: Die Polizisten waren außer Sichtweite, im Gegensatz etwa zu einem Scharfschützen, der sein Opfer sehen kann und sehen muss. Selbst wenn er durch ein Zielfernrohr schaut, hat er direkten Sichtkontakt zu dem Menschen, den er gleich umbringen wird. Die Kamera auf dem Roboter schafft dagegen Distanz, man sieht das Opfer nur auf einem Bildschirm. Außerdem werde die Verantwortung auf mehrere Schultern verteilt: eine Person, die die Lage einschätzt, eine weitere, die die Entscheidung gibt und schließlich die Person, die die Bombe zündet. "Das senkt auf jeden Fall die Hemmungen", sagt Kerr.

Menschen sind zu optimistisch, wenn es um tödliche Gewalt geht

Michael Kalichman, der das Center for Ethics in Science and Technology leitet, schließt sich Kerr an: Er habe sich zwar anfänglich gefreut, da Johnson bereits viele Menschen getötet hatte und "weil dies eine Möglichkeit war, etwas zu beenden, aus dem eine viel schlimmere Situation hätte erwachsen können."

Doch die Menschen seien zu optimistisch. Sie gingen davon aus, dass tödliche Gewalt, wie in diesem Fall geschehen, stets zielgenau eingesetzt würde. "In der Realität wird es oft anders laufen. Im Fall einer Bombe kann diese auch deutlich mehr Menschen das Leben kosten."

Kreativer Einsatz des Roboters

Eine andere Sicht vertritt Ryan Calo. Er ist Mitglied des Center for Internet and Society an der Stanford-Universität. Im Interview mit der Technik-Seite The Verge sagte er, dass es juristisch gesehen nicht auf die Art ankomme, wie ein Mensch getötet wurde. Viel entscheidender sei, ob von dieser Person eine unmittelbare Gefahr ausgehe: "Das ist eine Situation, in der sie (die Polizei) tödliche Gewalt anwenden darf." Es sei darum gegangen, die Öffentlichkeit zu schützen, die Beamten hätten den Roboter dafür "kreativ eingesetzt".

Calo zufolge habe es sich um eine Extremsituation gehandelt. Er hält es für unwahrscheinlich, dass sich ähnliche Einsätze in Zukunft häufen. Die Öffentlichkeit müsse sich nur Sorgen machen, wenn der Einsatz der Roboter zum Normalfall würde - davon sei momentan aber nicht auszugehen.

Der Ethiker Kalichman dagegen befürchtet genau das - und fordert deshalb, dass die Konsequenzen öffentlich diskutiert werden. "Das sollte nicht die Polizei, die Wissenschaftler oder das Militär entscheiden. Das ist eine Frage, die alle Menschen mit einbeziehen sollte."